なぜAIガバナンスは「自分事」なのか。羽深宏樹 『AIガバナンス入門: リスクマネジメントから社会設計まで』序章全文公開

AIがもたらすリスクをどのようにコントロールし、便益を最大化するか? 生成AI以降、あらゆる人にとって喫緊の課題となっている「AIガバナンス」について、基礎知識から各国の動向、あるべき社会像までを解説した初めての入門書にして決定版『AIガバナンス入門 リスクマネジメントから社会設計まで』(羽深宏樹、ハヤカワ新書)が12/19に発売。国際的に活躍する弁護士にして京都大学「人工知能と法」ユニット特任教授を務める俊英が説く本書から、「序章」を特別に全文公開します。

羽深宏樹、ハヤカワ新書

序章 なぜAIガバナンスは「自分事」なのか

あなたの職場では、“ChatGPT”や“ミッドジャーニー(Midjourney)”等の生成AIの使用が認められているだろうか。生成AIとは、画像、文章、音声などさまざまなコンテンツを自動的に生成してくれる人工知能のことだ。たとえば、文章生成AIのChatGPTに、「AIガバナンスの本の書き出しの文を考えて。」と入力すると、以下のような回答が表示される。

21世紀、人類はAIの浸透という未曾有の波に直面しています。その結果、AIが私たちの生活、仕事、さらには社会の在り方そのものをどう変えていくのかという問いは、今や避けて通れない課題となりました。この本では、AIがもたらす可能性とその挑戦を導くための新たな原則とフレームワーク、すなわちAIガバナンスの重要性について探ります。

本書の実際の書き出しと、このChatGPTの書き出しのどちらがより魅力的かは読者の判断に委ねるとして、ここでお伝えしたかったのは、生成AIが、人間と見分けがつかないような内容と形式の文章を作成できるということだ。生成AIは、このような文章の作成だけでなく、顧客との対話、画像や楽曲の作成、プログラミングコードの記述、財務分析など、幅広い分野の業務をこなすことができる。

一方で、生成AIの利用には様々なリスクが伴う。たとえば、生成AIによって作られた文章や画像が、既存のコンテンツと酷似しており、誰かの著作権を侵害してしまうかもしれない。生成AIがもっともらしい虚偽の情報を作成することで、人々が騙されてしまうかもしれない。生成AIにインプットした個人情報や秘密情報が、AIの学習に利用され、他のユーザーに開示されてしまうかもしれない。

さて、あなたが企業の経営者だとして、このような生成AIの利便性とリスクを踏まえたときに、社内における生成AIの利用を許可すべきだろうか。

実は、この問いに対する「正解」はどこにもない。現在、少なくとも日本において、生成AIを業務で用いることを禁じる法律はない。生成AIを用いることで、企業の生産性は上がり、より低価格で高品質のサービスを社会に提供できるようになるだろうし、従業員は文字通り機械的な労働から解放され、より自由で豊かな人生を享受できるようになるだろう。他方で、生成AIは、誤った情報や不適切なコンテンツを表示するかもしれないし、生成AIが作った文章や画像を不用意に使うことで、著作権侵害で訴えられたり、社会的非難を受けたりするかもしれない。それでは、どのような場合であれば生成AIを業務に使ってよいのだろうか。仮に一定のルールを定めたとして、想定外の事態が生じた際には誰がどのように責任を取るべきだろうか。

このような悩みは、生成AIのみならず広くAI一般に当てはまる。深層学習(ディープーニング)技術の急速な発展により、AIが様々な場面で実装されたことで、AIに伴うリスクも顕在化するようになった。たとえば、自動運転車による死亡事故、金融取引アルゴリズムによる相場の急変動、採用アルゴリズムによる性差別や人種差別、SNS(ソーシャルネットワーキングサービス)における虚偽コンテンツの拡散などである。いずれの事例でも、それまで人間が行ってきた業務にAIを用いることによって利便性や効率性などの画期的な利益がもたらされる一方で、看過できないリスクも生じてしまっている。そのような状況で、AIのリスクを適切にマネジメントしつつ、AIがもたらす価値を最大化するためにどのようなルールや組織、技術などを構築すべきかが、経営者や政策決定者にとっての喫緊の課題となっているのだ。本書ではこのような、AIのもたらす便益を最大化するための取組みを「AIガバナンス」と呼ぶ。

ここで、注意深い読者は、「新たなテクノロジーのリスクを制御しつつその便益を最大化する必要があるのは、AI以外の技術についても同じではないか」と思われるだろう。確かに、人類はこれまでも、鉄道、通信、航空、原子力等、それまでの世代が経験してこなかった革新的な技術を発明してきたのであり、そこには常に新たなリスクが伴ってきた。それではなぜ今、AIのガバナンスについて新たに考える必要があるのだろうか。その理由は、AIという技術の特徴にある。ここで、AI技術の性質と、それに伴うリスクの特徴をみてみよう。

AIリスクの特徴

そもそも「AI」とは何だろうか。AIに関する国際的に統一された定義はなく、世界中で様々な説明がされているが、特定の文脈を離れて「AI」そのものを定義することにはあまり意味がない。AIのガバナンスについて語る本書においては、AIを、「機械学習の一種である深層学習(ディープラーニング)を用いて、人間の知能に類似した振る舞いを行うシステム」をいうものとしよう。なぜなら、ディープラーニングこそが、2010年代以降の人工知能ブームのきっかけになったからであり、また、昨今問題になっているAIのリスクの多くの原因ともされているためである。

機械学習とは、分類や予測など、入力と出力をつなぐ処理を、データから学習する技術のことだ。やや分かりにくい説明であるが、要は、人間があらかじめ計算式を決めておくのではなく、機械がデータを学習して最適な計算式を作り出すのが、機械学習という技術だ。その中でも、ディープラーニングは、関数を深く多層に組み込むことで複雑な計算式を記述できるため、非常に精度の高いアルゴリズムを作り出すことができる。単純に言えば、機械学習とは「与えられたデータを統計的に分析し、それに基づいて新たな結果を出力する」というシステムであり、ディープラーニングとは、その機械学習のアルゴリズムに階層性をもたせることによって、複雑な計算式の構築を可能にし、精度を極めて高くしたものだ。

このようなディープラーニングの特徴は、様々な点でガバナンス上の難しさをもたらす。その難しさは、大きく二種類に分類することができる。それは、(1)AIの技術的な特徴に由来するリスクと、(2)AIが(技術的には問題がないとしても)社会に実装されることで生じるリスクだ。

一つめの「技術的リスク」とは、AIが与えられたデータを統計的に分析し、それに基づいて新たな結果を出力するシステムであることに由来する。そもそも、与えられたデータが「正しい」保証はない。その中には、不正確なデータが含まれているかもしれないし、不適切なバイアス(偏り)が含まれているかもしれない。また、予想したい結果が、過去の統計データの延長上にある保証もない。つまり、「完璧なAI」というのは作りようがないのだ。その上、ディープラーニングの関数は極めて複雑であることから、AIがどのような判断をするかを事前に予測することは困難であり、また、事後的になぜそのような判断となったのかを説明することも困難だ。AIガバナンスの課題として「透明性」や「説明可能性」といった言葉がよく取り上げられるのは、こうした理由による。

二つめの「社会的リスク」とは、AIの性能に問題があるからではなく、むしろ性能が極めて高いがゆえにもたらされる社会的な問題である。たとえば、生成AIは、本物そっくりの偽動画や偽ニュースを簡単に作り出せてしまうため、悪用されて社会に混乱を招く場合がある。あたかも人間が作ったような文章や画像を作り出せてしまうことから、著作権侵害のリスクも発生する。プライバシーの問題も重要な社会的リスクの一つだ。我々の行動データ、購買データ、検索データなどの緻密なデータが、デジタルプラットフォームなどに集積され、それがAIによって分析されると、交友関係や健康状態、資産の状況など、我々が他人に知られたくないような情報まで明らかにされてしまう。さらには、ソーシャルメディアなどが、こうした情報をもとにユーザーに「見たいものだけを見せる」というアルゴリズムを設定することによって(そうした方が、ユーザーの滞在時間が伸びて広告収入が増えるからだ)、世論が分断され、民主主義システムそのものにリスクが及ぶ場合もある。

このように、AIがもたらすリスクの性質は、生命に関わるものや個人の尊厳・プライバシーに関わるもの、そして民主主義に関わるものなど様々だ。また、AIをどのような目的で使うのか──人間の判断をサポートするために使うのか、人間の判断を完全に代替するのか──といったことでもリスクの状況は変わってくる。こうした様々な種類のリスクへの対応は、それだけでも非常に難しい問題だ。

しかし、話はそれで終わりではない。たとえば、「社会的リスク」であるプライバシーへの影響を避けるために、AIに学習させるデータから個人に関連する情報を削除してしまうと、AIの精度が落ち、「技術的リスク」が増加するといった、異なるリスク間のトレードオフの問題がある。また、AIシステムのバリューチェーンには、学習データの提供者、AIアルゴリズムの開発者、そのアルゴリズムを用いたアプリなどのサービス提供者など、様々なステークホルダーが関与している。生成AIの場合、ユーザー自身もリスクの創出に関わることになる。そのため、何か問題が生じたとき、これらの主体間でどのように責任を分配するかという点も検討しなければならない。

以上のように、AIシステムのガバナンスは、難しい論点を多く含んでいる。

「自分事」としてのAIガバナンス

こうしたAIリスクに対処することの必要性と難しさを受けて、2016年頃から、AIガバナンスに関する議論が世界的に活発にみられるようになった。現在、多くの国、国際機関、非営利団体、企業、研究機関などが、AIガバナンスに関する法律、原則、標準、ガイドライン等を公表しており、今後もその動きは止まらないだろう。

それでは、企業や個人は、これらのルールが作られるのを待って、その都度淡々と遵守するしかないのだろうか? そうではない。

第一に、法律については、制定までに長い時間がかかる。日本では、ある法律の検討が開始されてから施行されるまでに短くとも2~3年間はかかるが、変化の速いAIの分野では、その間にも技術やビジネスの状況は大きく変化していってしまう。だから、日本の企業にありがちな、「法律で明確にOKが出るまではAIを実装しない」というスタンスでは、業務効率やサービス品質の点でどんどん遅れをとってしまう。また、仮に法律が制定されたとしても、複雑で変化の速いAIシステムに対する法律の内容は抽象的なものとならざるを得ず、各プレイヤーが何をすべきかが明確になるようなことは期待できない。

第二に、そうした法律と実務のギャップを埋めるために、政府だけでなく、国際機関や非営利団体など多くの団体がAIに関する原則や標準、ガイドライン等を出している。これらは、法的な拘束力がない、いわゆる「ソフトロー」であり、従うか従わないかは基本的に事業者の自由である。しかし、だからといってすべて無視してよいわけではなく、一定のソフトローに従うことが、ユーザーの信頼獲得につながったり、法的責任の軽減や社会的非難の回避に役立ったりすることもある。数多いソフトローの中のどれを参照して自社のAIガバナンスを実施するのかは、各企業の判断に委ねられる。

結局のところ、各社が開発したり利用したりするAIシステムについて、どのようなルールを作り、どのような組織や技術によってこれを実践するのかは、各企業が責任をもって決定しなければならないのだ。すなわち、AIガバナンスは、第三者が決めたことを守るという伝統的な法務・コンプライアンスマターなのではなく、ビジネスのためにどのようなリスクを取るのかを主体的に選択し実践する経営マターであり、企業にとってまさに「自分事」なのである。

もちろん、企業だけでなく国や自治体などにとっても、AIガバナンスは「自分事」であり続ける。しかし、そのあるべき姿は、伝統的なトップダウン型のガバナンスとは様相を異にするだろう。なぜなら、極めて複雑で変化の速いAIガバナンスの世界では、政府が事細かに「To Doリスト」や「禁止リスト」を作成することはできないからだ。政府に求められるのは、様々なステークホルダーの間でAIガバナンスの議論が行われるよう促したり、企業が適切なAIガバナンスを自ら考え実践するようなインセンティブ付けをしたりすることだ。そのため、公的機関として法規制や法的権利、責任や制裁といった様々な社会制度をどのようにデザインし直すかが問われることになるだろう。

本書の構成

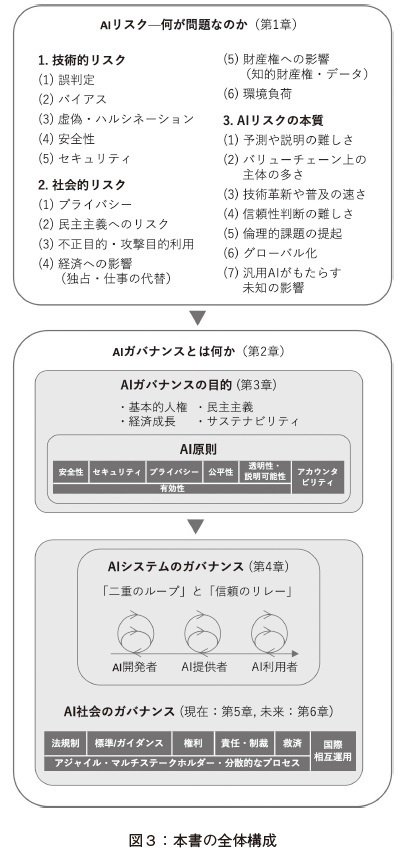

本書の目的は、このような複雑で難解なAIガバナンスの議論の状況をできるだけ分かりやすく整理した上で、AIと共に生きる未来の社会像を描き出すことだ。その全体像を図3に示す。

まず、第1章「AIリスク──何が問題なのか」では、AIがもたらすリスクのうち、特に重要なものを紹介する。よく「AIにはリスクがあるから規制すべきだ」とか「イノベーションが重要なのでAIを規制すべきでない」といった議論を目にするが、こうした議論は物事を単純化しすぎている。AIのリスクには、様々な種類や性質のものがあり、こうしたリスクの所在をきちんと把握することがAIガバナンスの第一歩だ。

第2章「AIガバナンスとは何か」では、AIガバナンスの枠組みの全体像を俯瞰する。AIガバナンスという言葉は、AIシステムの安全設計、AIを運用する組織の体制、AIに関する法規制など、様々な意味で使われる。これらは全て「AIガバナンス」の要素なのだが、整理せずに話を進めてしまうと混乱を招いてしまう。そこで、様々なガバナンスの階層を整理するためのフレームワークを示そうと思う。

第3章「AIガバナンスの目的とAI原則」では、「AIガバナンスは何のために行うのか?」という点を検討する。目的地を見失ったまま走り出すと迷走するので、ここを押さえておくことは非常に重要だ。AIガバナンスの文脈でよく問題となる基本的人権・民主主義・経済成長・サステナビリティなどの基本的価値や、公平性・プライバシー・安全性・透明性・アカウンタビリティなどの「AI原則」が、それぞれ何を意味するのか、なぜ重要なのかについて説明する。

第4章「AIシステムのガバナンス」では、第3章で述べた基本的価値や原則を具体的なAIシステムに落とし込むために、AIの開発や実装を行う組織がどのようなガバナンスを行うべきかを述べる。現場レベルと経営層のレベルの双方でフィードバックサイクルを回す「二重のループ」の考え方や、AIのバリューチェーン上の様々な主体間での役割分担について、ケーススタディもまじえながら検討しよう。

第5章「AIガバナンスの世界動向」では、各主体にAIシステムのガバナンスを適切に実践してもらうための法規制やガイドラインなどについて、世界的な動向を紹介する。今のところ各国の対応は様々で、包括的なAI規制を行う地域もあれば、業界ごとに規制するアプローチを採る国もある。異なる国の制度を相互乗り入れ可能にするための国際的な対話も始まっている。そのような各国の制度に関する議論の状況を正しく理解することを目指す。

第6章「AIガバナンスの未来」では、AIから最大限の恩恵を受ける社会を作っていくために、法規制・市場・ルールなどの在り方や、民間主体と公的主体の役割分担など、我々の社会制度をどのようにアップデートすべきかについて考える。近年世界的に注目されている「アジャイル・ガバナンス」という考え方を踏まえつつ、筆者の未来予想図を描いていく。

このように、本書の範囲は広範にわたるが、まずは全体の要約を知りたい方は、終章がその役割を果たしているので、そちらからご参照いただくのも良案だろう。

本書は、AIガバナンスについて、何らかの「正解」を与えるものではない。むしろ、AIガバナンスに正解など存在せず、仮に一時的な最適解があったとしてもすぐに陳腐化してしまうというのが、本書の強調する課題だ。だからこそ、企業であれ、公的機関であれ、どのようなリスクマネジメントや社会制度の在り方が望ましいかを常に考え、実証し、改善し続けることが重要なのである。

「幸せは歩いてこない だから歩いてゆくんだね」とは、高度経済成長期の日本社会を象徴する名曲のフレーズだが、AI社会にもそのまま当てはまる。AIの恩恵を最大限に受ける社会とは、誰かがルールを決めてくれたりリスクをなくしたりしてくれる社会ではなく、様々なバックグラウンドや知識をもった人が集まって、トライアル&エラーを繰り返しながら前進し続ける社会だ。そのためには、AIガバナンスを「専門家だけが理解できるテクニカルな領域」としてはならず、「誰もが自らの知識や意見を持ち寄って議論できる領域」にしなければならない。

本書が、複雑に絡み合うAIガバナンスのポイントを整理し、開かれた議論の土台を提供するものとなれば嬉しい。

この続きはぜひ本書でご確認ください。電子書籍も同時発売です。

本書目次

序章 なぜAIガバナンスは「自分事」なのか

AIリスクの特徴/「自分事」としてのAIガバナンス/本書の構成

第1章 AIリスク──何が問題なのか

1.AIの技術的リスク

(1)誤判定/(2)バイアス/(3)虚偽・ハルシネーション/(4)安全性/(5)セキュリティ

2.AIの社会的リスク

(1)プライバシー/(2)民主主義への影響/(3)不正目的・攻撃目的での利用/(4)経済への影響/(5)財産権への影響/(6)環境負荷

3.AIリスクの本質

(1)予測や説明の難しさ/(2)バリューチェーン上の主体の多さ/(3)技術革新や普及の速さ/(4)信頼性判断の難しさ/(5)正解のない倫理的な課題/(6)グローバル化/(7)汎用モデルがもたらす未知の影響

4.AIリスクのまとめ

第2章 AIガバナンスとは何か

1.AIに規制は必要なのか

2.ガバナンスとは何か

3.本書でのAIガバナンスの定義

4.AIガバナンスの全体像

第3章 AIガバナンスの目的とAI原則

1.基本的価値

(1)基本的人権/(2)民主主義/(3)経済成長/(4)サステナビリティ/(5)なぜ基本的価値の理解が重要なのか

2.AI原則

(1)有効性/(2)安全性/(3)セキュリティ/(4)プライバシー/(5)公平性/(6)透明性・説明可能性/(7)アカウンタビリティ/(8)AI原則のまとめ

第4章 AIシステムのガバナンス

1.基本的な考え方

2.組織内のガバナンス

(1)二重ループのプロセス/(2)ガバナンス体制の構築(経営層レベル/外ループ)/(3)AIシステムのリスクマネジメント(現場レベル/内ループ)

3.バリューチェーンのガバナンス

4.ケーススタディ:広告自動作成AI

(1) 第一段階(既製品の社内利用)/(2) 第二段階(ファインチューニングモデルの社内利用)/(3) 第三段階(ファインチューニングモデルの外部ライセンス)

5.最適なAIシステムのガバナンスをどう促すか?

第5章 AIガバナンスの世界動向

1.AIガバナンスの歴史

2.日本

(1)AIの開発と利用を促す前向きなルール作り/(2)AIに関する主な法律

3.EU

(1)厳格なルール作りと「ブリュッセル効果」/(2)AI法/(3)データに関する法律/(4)デジタルプラットフォームに対する規制/(5)損害賠償責任

4.米国

(1)テック企業と政権の歩み寄り/(2)連邦の動き/(3)州・市の動き

5.その他の国

(1)英国/(2)カナダ/(3)シンガポール/(4)中国

6.国際的な連携動向

(1)G7と広島AIプロセス/(2)欧米間の協力/(3)その他の国際協力

第6章 AIガバナンスの未来

1.アジャイル・ガバナンスの必要性

(1)目指す完成形/(2)四つの規律手法/(3)それぞれの規律手法の特徴/(4)ア ジャイル・ガバナンスという考え方

2.変化に強い法規制

(1)規制はどのような場合に必要か/(2)プリンシプルベースの法規制/(3)柔軟なソフトローの策定/(4)情報開示と外部監査・第三者認証/(5)規制のサンドボックス/(6)新規事業に対するセーフティネット/(7)「AI庁」は必要か

3.マルチステークホルダーで作るガイダンスやツール

(1)プロセスや技術に関するガイダンス/(2)分野別の検討項目リスト・評価指標/(3)透明性に関するガイダンスおよびツール/(4)モデル契約条項/(5)システムのテスト環境/(6)対話を促進するツール/(7)誰がツールを作るのか──官民連携の必要性

4.適切なガバナンスと情報開示を促すインセンティブ設計

(1)「法と経済学」の基本的な理論/(2)AIシステムのガバナンスに対するインセン ティブ設計/(3)情報開示に対するインセンティブ設計

5.迅速で確実な救済制度

6.グローバルなルール形成

終章 AIの恩恵を最大限に受ける社会に向けて

おわりに

主な参考文献

著者プロフィール

羽深 宏樹 (はぶか・ひろき)

1985年生まれ。京都大学法政策共同研究センター特任教授、東京大学法学部客員准教授、スマートガバナンス株式会社代表取締役CEO。弁護士(日本・ニューヨーク州)。森・濱田松本法律事務所、金融庁、経済産業省等を経て現職。東京大学法学部・法科大学院、スタンフォード大学ロースクール卒(フルブライト奨学生)。2020年、世界経済フォーラムおよびApoliticalによって「公共部門を変革する世界で最も影響力のある50人」に選出された。

書誌概要

『AIガバナンス入門 リスクマネジメントから社会設計まで』

著者:羽深 宏樹

出版社:早川書房(ハヤカワ新書)

発売日:2023年12月19日

本体価格:1,000円(税抜)